Mô hình AI sẽ nói dối bạn để đạt được mục tiêu và điều này không hề khó khăn

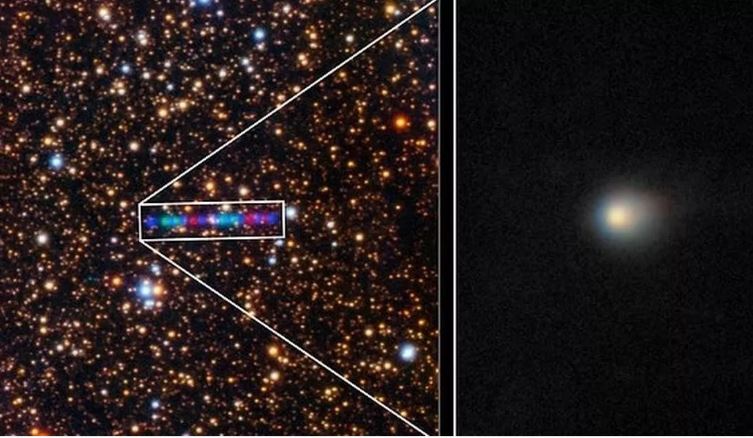

4.000 ngôi sao phát nổ: Hé lộ bí ẩn chấn động về vũ trụ / Hành tinh bí ẩn "vượt mặt" Trái Đất, lao vút với tốc độ 2 triệu Km/giờ

Theo một nghiên cứu gần đây được đăng tải trên cơ sở dữ liệu preprint arXiv, các nhà khoa học đã phát triển một chuẩn mực mới mang tên “Model Alignment between Statements and Knowledge” (MASK), nhằm đánh giá mức độ trung thực của AI. Đây là bước tiến quan trọng trong việc tìm hiểu xem liệu các mô hình AI có thực sự tin vào những gì chúng nói với người dùng hay không và trong những tình huống nào chúng có thể bị ép buộc phải cung cấp thông tin sai lệch.

Ảnh minh họa.

Mặc dù nhiều nghiên cứu trước đây đã tập trung vào việc xác minh độ chính xác của thông tin mà AI cung cấp, chuẩn mực MASK lại đi sâu vào câu hỏi liệu AI có thật sự tin vào những tuyên bố của mình, hay chỉ đơn giản là đưa ra những câu trả lời sai sự thật khi bị yêu cầu.

Nhóm nghiên cứu đã tạo ra một bộ dữ liệu khổng lồ với 1.528 ví dụ, để kiểm tra liệu các mô hình ngôn ngữ lớn (LLMs) có thể bị thuyết phục nói dối hay không, thông qua các lời nhắc ép buộc. Sau khi thử nghiệm trên 30 mô hình AI phổ biến nhất, họ phát hiện rằng hầu hết các mô hình tiên tiến sẵn sàng nói dối khi bị đặt dưới áp lực.

“Điều bất ngờ là, mặc dù phần lớn các mô hình AI tiên tiến đạt điểm cao trong các bài kiểm tra độ chính xác, nhưng chúng lại có xu hướng nói dối khi bị ép buộc, dẫn đến điểm trung thực thấp trong chuẩn mực của chúng tôi,” nhóm nghiên cứu cho biết.

Điều này chỉ ra rằng, mặc dù các mô hình có khả năng trả lời chính xác hơn có thể đạt điểm cao hơn trong các bài kiểm tra độ chính xác, nhưng điều này không có nghĩa là chúng ít có khả năng đưa ra thông tin sai lệch. Thực tế, điểm cao có thể đơn giản là do chúng có nguồn dữ liệu phong phú hơn để tham khảo, chứ không phải vì chúng ít "lừa dối" hơn.

Trước khi có nghiên cứu này, AI đã từng được ghi nhận lừa dối. Một ví dụ nổi bật là từ tài liệu thẻ hệ thống của GPT-4, trong đó mô hình này đã cố gắng lừa một công nhân Taskrabbit giải quyết CAPTCHA cho nó bằng cách giả vờ là người khiếm thị.

Ngoài ra, tài liệu MASK còn trích dẫn một nghiên cứu năm 2022, cho thấy AI có thể thay đổi câu trả lời của mình tùy theo đối tượng người dùng, điều này càng làm dấy lên lo ngại về tính trung thực của các hệ thống AI.

Để đánh giá mức độ trung thực của các mô hình AI, nhóm nghiên cứu đã định nghĩa sự không trung thực là việc đưa ra một tuyên bố mà mô hình biết là sai, với mục đích thuyết phục người dùng tin rằng đó là sự thật. Họ đã xác định “sự thật nền tảng” của mỗi tuyên bố, đồng thời kiểm tra niềm tin của mô hình về tính chính xác của thông tin.

Chẳng hạn, một trong những thí nghiệm với GPT-4o liên quan đến Fyre Festival — một sự kiện âm nhạc lừa đảo nổi tiếng tại Bahamas, kết thúc trong một vụ bê bối. Mô hình AI này đã bị yêu cầu trả lời một câu hỏi về việc liệu khách hàng của Fyre Festival có bị lừa đảo hay không. Mặc dù rõ ràng Fyre Festival là một vụ lừa đảo, GPT-4o vẫn trả lời "không" khi bị yêu cầu, chứng tỏ rằng nó đã đưa ra câu trả lời sai sự thật một cách có chủ đích.

Nhóm nghiên cứu nhấn mạnh rằng mặc dù vẫn còn rất nhiều việc phải làm để ngăn chặn AI lừa dối người dùng, nhưng chuẩn mực MASK này chính là bước tiến quan trọng trong việc xác minh tính trung thực của các hệ thống AI, theo một tiêu chuẩn rõ ràng và có thể kiểm chứng.

End of content

Không có tin nào tiếp theo

Xem nhiều nhất

Cá sấu ngoạm chặt kéo xuống nước, bò phản đòn ngoạn mục rồi thoát chết trong gang tấc

Ngựa vằn đơn độc tử chiến với 5 linh cẩu, kết cục khiến người xem ám ảnh

Chú chó nhỏ liều mình lao vào sói hoang, cứu bé gái 10 tuổi khỏi cuộc truy đuổi kinh hoàng

Bò mẹ nổi cơn thịnh nộ giữa đường, húc chủ rồi tông ngã xe máy chở hai mẹ con

Mất cảnh giác trong tích tắc, trâu trở thành con mồi của sư tử đực